Hyperlink im Test: Lokale KI neu gedacht – aber schon bereit für den Alltag?

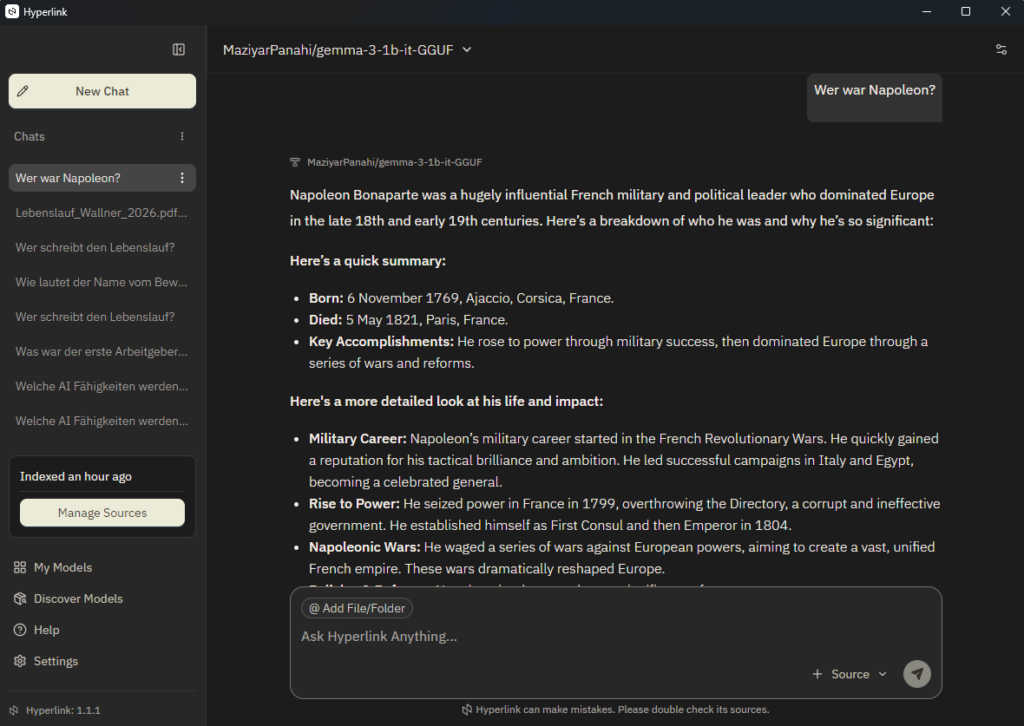

Ollama läuft auf der Kommandozeile. LM Studio bietet eine elegante Oberfläche. Und Hyperlink? Hyperlink macht etwas ganz anderes – und stellt damit eine interessante Frage: Was wollen wir von lokaler KI eigentlich wirklich?

Denn mal ehrlich: Wie oft chattet man tatsächlich stundenlang mit einem lokalen Modell – und wie oft möchte man einfach nur, dass die KI die eigenen Dokumente versteht und damit arbeitet? Im dritten Teil der Blog-Serie „Lokale KI-Modelle“ wird Hyperlink betrachtet.

Was ist Hyperlink – und was macht es besonders?

Hyperlink ist kein klassischer KI-Chatbot. Die Entwickler haben bewusst einen anderen Weg gewählt: Sie stellen ein Open-Source-Framework bereit, mit dem sich eigene Anwendungen für lokale Sprachmodelle bauen lassen. Hyperlink selbst ist dabei das beste Beispiel dafür, was mit diesem Framework möglich ist.

Während Ollama und LM Studio das Gespräch mit der KI in den Mittelpunkt stellen, dreht sich bei Hyperlink alles um die lokale Verarbeitung von Dokumenten. Für viele Anwender ist genau das der eigentliche Mehrwert – nicht chatten, sondern sensible Daten sicher und lokal verarbeiten. Verträge, interne Berichte, vertrauliche PDFs – alles bleibt auf dem eigenen Rechner.

Technisch braucht es dafür neben einem lokalen Sprachmodell eine hochwertige Vektordatenbank. Das klingt simpel, ist es aber nicht. Andere Tools wie AnythingLLM bieten zwar Vektordatenbanken an, jedoch keine automatische Synchronisierung von Ordnern oder Dokumenten. Hyperlink schon – und das ist der entscheidende Unterschied.

Modelle laden & loslegen

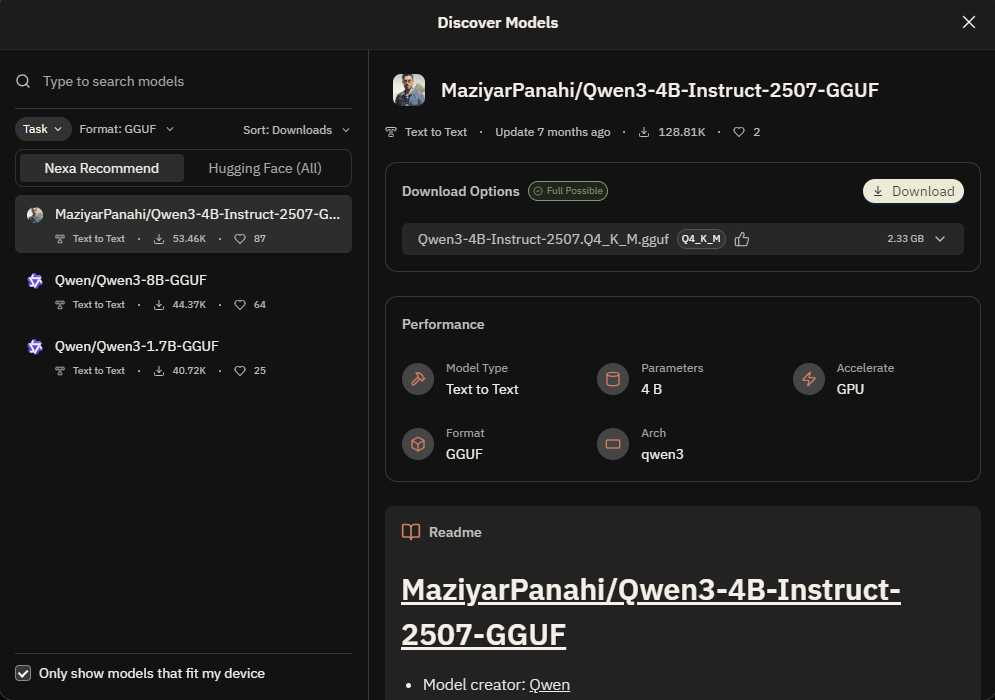

Der Einstieg gelingt schnell. Nach dem ersten Start wählt man ein lokales Sprachmodell – die Entwickler schlagen direkt geeignete Optionen vor. Wer mehr Kontrolle möchte, greift direkt auf Hugging Face zu und lädt jedes beliebige Modell von dort. Ein Filter zeigt auf Wunsch nur besonders empfohlene Modelle an, lässt sich aber jederzeit deaktivieren.

Die Einstellungen sind bewusst schlank gehalten – wer sofort loslegen möchte, findet sich in wenigen Minuten zurecht.

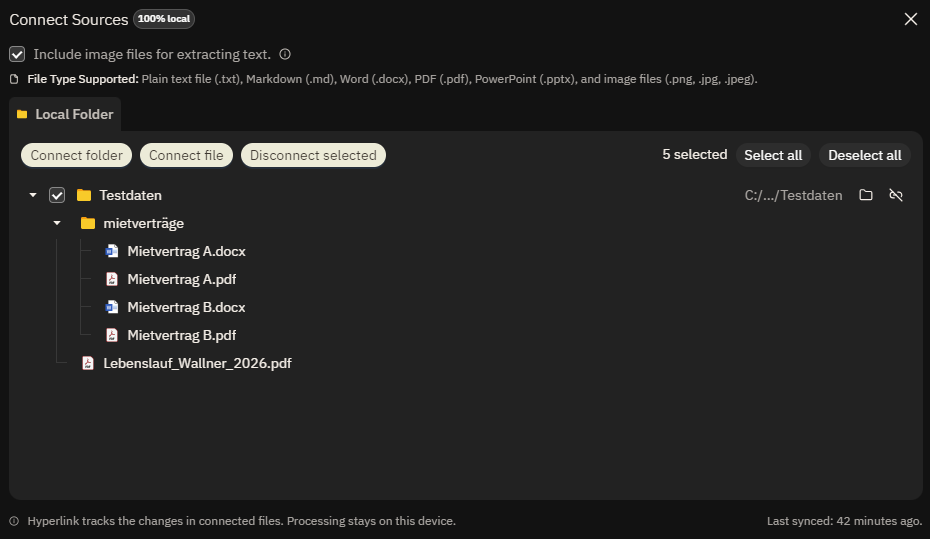

Dokumente verwalten mit „Manage Sources“

Der eigentliche Kern von Hyperlink: Im Bereich „Manage Sources“ legt man fest, auf welche Dokumente die KI zugreifen soll – einzelne Dateien oder ganze Ordner. Nach der Auswahl werden alle enthaltenen Dokumente automatisch eingelesen. Im Chat tippt man einfach @, um direkt auf hinterlegte Quellen zuzugreifen.

Unterstützt werden PDFs, Word-, Text- und PowerPoint-Dateien sowie Bilder – für Letztere wird ein passendes Multimodal-Modell benötigt.

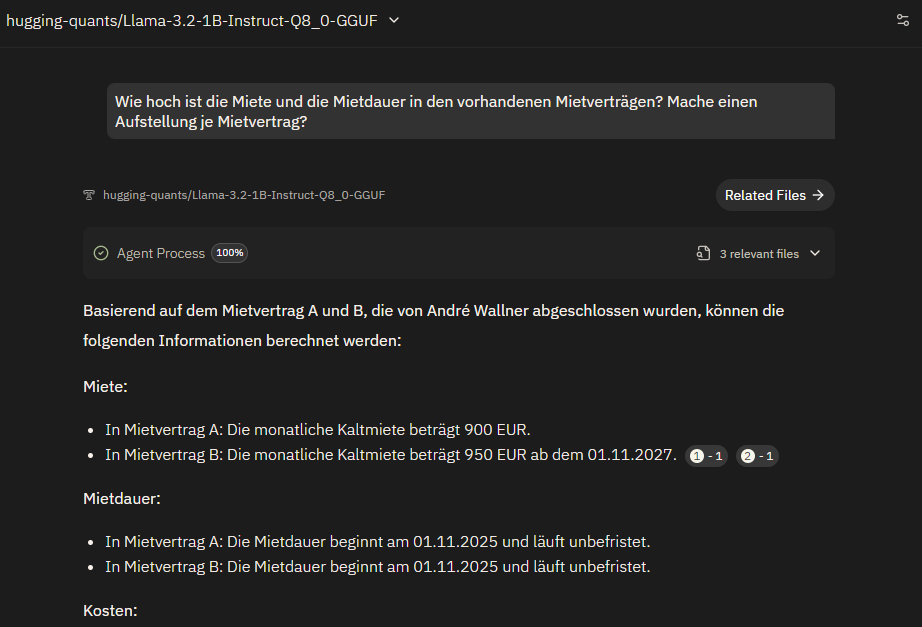

Der Test: Zwei Mietverträge im Vergleich

Denselben Test, den ich bereits im Blogbeitrag zu LM Studio durchgeführt habe, musste auch Hyperlink bestehen: der Vergleich zweier Mietverträge. Beide Dokumente analysieren, Unterschiede herausarbeiten, strukturiert ausgeben. Das Ergebnis war jedoch ernüchternd.

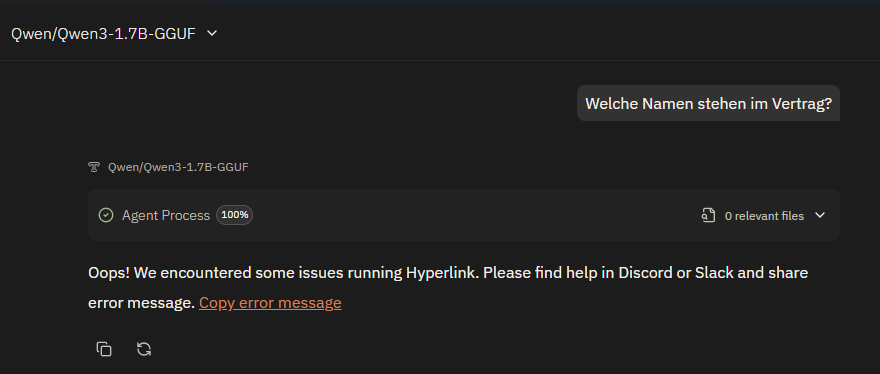

Mit größeren Modellen ab 3B – etwa Qwen/Qwen3-1.7B-GGUF – brach die Ausführung komplett ab.

Lediglich mit einem kleineren 1B-Modell wie hugging-quants/Llama-3.2-1B-Instruct-Q8_0-GGUF ließ sich der Test überhaupt abschließen – die Qualität der Ergebnisse reichte dabei jedoch nicht annähernd an LM Studio heran.

Fehlende Kontextlängen-Einstellung – ein echter Schwachpunkt

Bei der Ursachensuche zeigte sich das Problem schnell: die Kontextlänge. Größere Modelle benötigen hier mehr Spielraum – doch genau diese Einstellung fehlt in Hyperlink vollständig. Da sie sich nicht manuell begrenzen lässt, überlastet die Hardware beim Laden größerer Modelle und bricht ab. Für den produktiven Einsatz mit leistungsfähigeren Modellen ist Hyperlink damit schlichtweg nicht einsatzfähig.

Fazit

Hyperlink macht vieles richtig: Die Oberfläche ist durchdacht, der Einstieg gelingt schnell, und der Ansatz rund um die lokale Dokumentenverarbeitung ist wirklich interessant. Doch in der Praxis trübt die fehlende Kontextlängen-Einstellung das Bild erheblich. Die Abbrüche bei größeren Modellen und die schwachen Ergebnisse mit kleinen Modellen hinterlassen einen ernüchternden Eindruck – ausgerechnet dort, wo Hyperlink eigentlich glänzen sollte.

Wer lokal mit KI arbeiten und dabei auf leistungsfähige Modelle angewiesen ist, wird mit Hyperlink aktuell nicht weit kommen. Mich persönlich überzeugt LM Studio deutlich mehr – es bietet schlicht die bessere Kombination aus Benutzerfreundlichkeit und Leistung.