Ollama oder LM Studio: Dein Einstieg in die Welt lokaler KI-Modelle

Im zweiten Teil der Blog-Serie „Lokale KI-Modelle“ gehe ich näher auf Ollama und LM Studio ein. In diesem Artikel zeige ich dir außerdem, wie du mit LM Studio in wenigen Schritten deine eigene lokale KI zum Laufen bringst.

Was ist Ollama und warum ist es interessant?

Ollama ist ein Open-Source-Kommandozeilenwerkzeug, das es dir ermöglicht, leistungsstarke Sprachmodelle lokal auf deinem Rechner auszuführen. Anders als bei Cloud-basierten KI-Diensten bleiben deine Daten bei dir – perfekt für sensible Dokumente oder wenn du einfach mehr Kontrolle über deine Informationen haben möchtest.

Das Besondere: Ollama ist vollständig quelloffen und kostenlos nutzbar – ohne Einschränkungen, ob privat oder beruflich. Der Quellcode liegt offen auf GitHub, die Community entwickelt das Projekt aktiv weiter, und du kannst Ollama sogar selbst anpassen oder erweitern.

Im Gegensatz zu LM Studio, das eine grafische Benutzeroberfläche bietet, setzt Ollama auf die Kommandozeile und eine lokale API. Das klingt zunächst technischer – ist aber genau das, was es so flexibel macht: Ollama lässt sich nahtlos in eigene Anwendungen, Skripte oder Entwicklungsumgebungen einbinden und spricht dieselbe API-Sprache wie OpenAI, nur komplett lokal. Wer also KI nicht nur nutzen, sondern wirklich integrieren möchte, ist mit Ollama oft besser bedient.

Was ist LM Studio und warum ist es interessant?

LM Studio ist eine Desktop-Anwendung, die es dir ermöglicht, leistungsstarke Sprachmodelle lokal auf deinem Rechner auszuführen. Anders als bei Cloud-basierten KI-Diensten bleiben deine Daten bei dir – perfekt für sensible Dokumente oder wenn du einfach mehr Kontrolle über deine Informationen haben möchtest.

Das Besondere: Die Software ist kostenlos nutzbar und lässt sich seit der neuen Lizenzregelung auch problemlos im beruflichen Umfeld einsetzen. Ob du nun als Freelancer arbeitest, in einem Unternehmen tätig bist oder einfach privat mit KI experimentieren möchtest – LM Studio steht dir offen.

LM Studio ist zwar kostenlos, aber nicht Open Source. Das unterscheidet es von Alternativen wie Ollama, die komplett quelloffen sind.

Der große Vorteil: Direkte Integration mit Hugging Face

Hugging Face ist die weltweit größte Plattform für KI-Modelle – eine Art „GitHub für künstliche Intelligenz“. Dort findest du Tausende kostenlose Sprachmodelle, von kleinen Spezialisten bis hin zu universellen Allroundern.

LM Studio und Ollama: Zwei Wege zum gleichen Ziel

Um zu verstehen, was LM Studio besonders macht, lohnt sich ein Blick auf das Zusammenspiel mit Ollama. Beide Tools verfolgen das gleiche Ziel – lokale KI-Modelle auf deinem Computer nutzbar zu machen – gehen dabei aber völlig unterschiedliche Wege. Das Gute: Du musst dich nicht entscheiden, sondern kannst beide kostenlos parallel nutzen und so von den jeweiligen Stärken profitieren.

Die Ausgangssituation ist bei beiden gleich: Große Tech-Unternehmen und Forschungseinrichtungen veröffentlichen ihre KI-Modelle als Open Source auf Plattformen wie Hugging Face. Das ist wie eine riesige Bibliothek, in der jeder kostenlos Zugriff auf leistungsstarke Sprachmodelle hat. Weil diese Modelle frei verfügbar sind, können sie beliebig verändert und angepasst werden – aus einem ursprünglichen Modell entstehen so schnell Hunderte oder sogar Tausende verschiedene Varianten. Das führt zu einer enormen Vielfalt, macht die Auswahl aber auch ziemlich unübersichtlich.

Hier kommen Ollama und LM Studio ins Spiel, die beide als Vermittler zwischen dir und dieser Modellvielfalt fungieren. Ollama funktioniert dabei wie ein kuratiertes Museum: Das Team wählt aus der Fülle an Modellen die besten aus, optimiert sie für den Alltag und macht sie mit wenigen Klicks nutzbar. Du bekommst also eine übersichtliche Auswahl getesteter, zuverlässiger Modelle – perfekt, wenn du nicht stundenlang recherchieren möchtest. Ein zusätzlicher Vorteil: Ollama richtet die Modelle so auf deinem Computer ein, dass auch andere Programme darauf zugreifen können. So kannst du beispielsweise lokale Chatbots wie AnythingLLM oder Automatisierungstools wie n8n mit denselben Modellen betreiben.

LM Studio verfolgt einen anderen Ansatz und gibt dir den direkten Zugang zur kompletten Hugging-Face-Bibliothek – ohne jede Vorsortierung. Das bedeutet: Du hast Zugriff auf über zwei Millionen verschiedene Modelle und Varianten. Klingt erstmal überwältigend? Keine Sorge: LM Studio analysiert automatisch deinen Computer und gibt dir konkrete Empfehlungen, welche Modelle bei deiner Hardware gut funktionieren sollten. So behältst du trotz der riesigen Auswahl den Überblick und kannst auch exotischere oder brandneue Modelle ausprobieren, die bei Ollama vielleicht noch nicht verfügbar sind.

LM Studio: Installation und erste Schritte

Die Installation von LM Studio ist denkbar einfach – wie bei jeder anderen Desktop-Software auch. Du lädst das Programm herunter, installierst es und startest es. Nach der Aktivierung landest du auf der Startseite.

Ein kleiner Tipp für den Anfang: Klicke unten auf den Button „Power User“. Dadurch werden erweiterte Optionen in der Sidebar sichtbar, die dir mehr Kontrolle über deine Modelle geben.

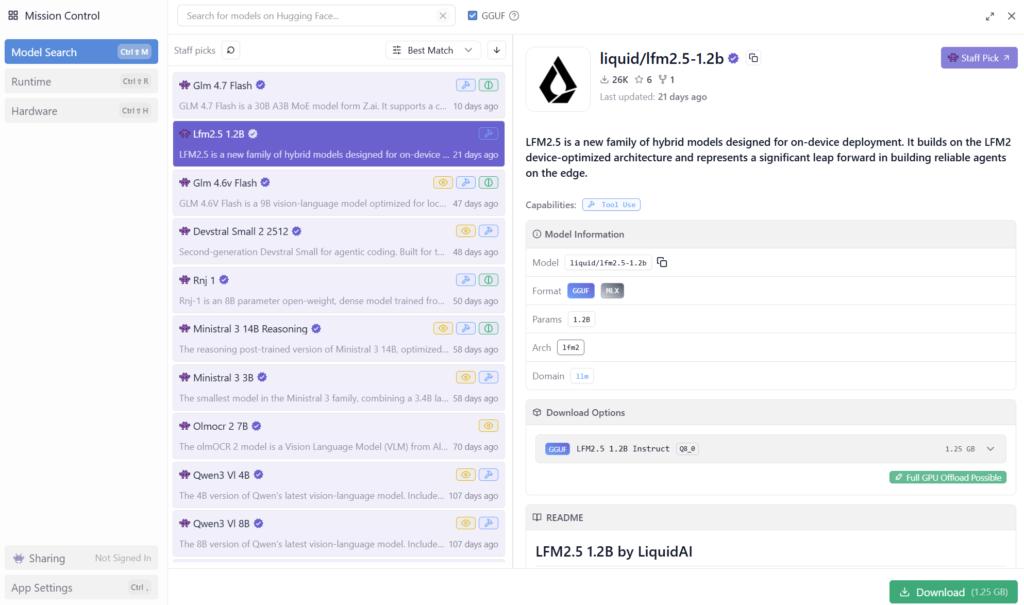

LM Studio: Dein erstes Modell finden und herunterladen

Über das Lupen-Icon in der Sidebar gelangst du zur Modellübersicht. Hier siehst du eine Auswahl verfügbarer Sprachmodelle, die du direkt herunterladen kannst.

Besonders hilfreich für Einsteiger: Modelle mit einem lila Häkchen sind von LM Studio empfohlen. Sie wurden gründlich getestet, laufen stabil und sind gut optimiert. Perfekt für den Start!

Wenn du auf ein Modell klickst, zeigt dir LM Studio rechts die wichtigsten Parameter an. Das macht die Auswahl deutlich übersichtlicher als auf Hugging Face selbst, wo die Informationen oft etwas technischer präsentiert werden. Wie solche Modellnamen zu verstehen sind habe ich unter LOKALE MODELLE beschrieben.

LM Studio: Download und los geht’s mit dem Chatten

Hast du dich für ein Modell entschieden? Dann einfach auf den Download-Button klicken. Du siehst links in der Sidebar, wie weit der Download ist und wo auf deinem Computer das Modell gespeichert wird.

Das Praktische: Du musst nicht warten, bis der Download abgeschlossen ist. Du kannst LM Studio währenddessen normal weiternutzen – und sogar schon mit bereits heruntergeladenen Modellen chatten.

Sobald ein Modell geladen ist, aktivierst du es über die obere Leiste auf der Startseite. Dann kann das Chatten losgehen! Jeder Chat bekommt automatisch einen Namen, den du jederzeit anpassen oder komplett löschen kannst. Über das Stift-Icon oben links kannst du außerdem jederzeit neue Chats starten.

LM Studio: Dokumente hochladen und analysieren lassen

LM Studio kann nicht nur chatten – du kannst auch Dokumente hochladen und das Modell damit arbeiten lassen. Beim ersten Upload erklärt dir die Software, was möglich ist und wo die Grenzen liegen.

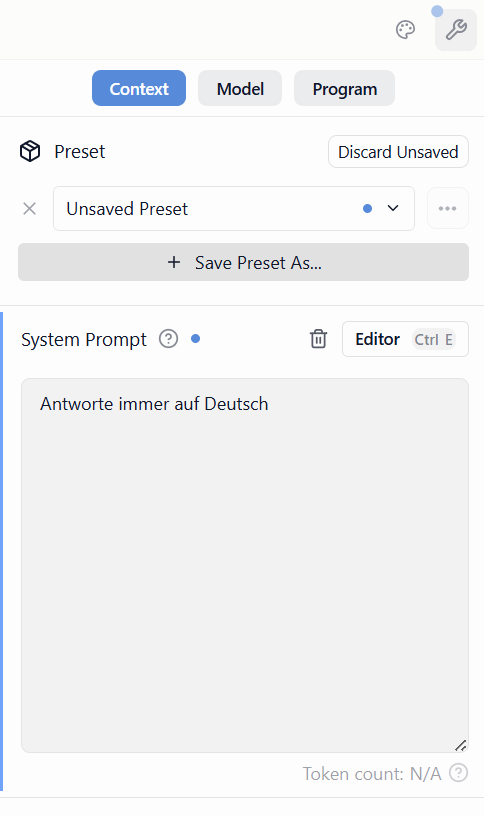

LM Studio: Sprache und Verhalten steuern mit Systemprompts

Manchmal antwortet ein Modell in der falschen Sprache oder nicht ganz so, wie du es dir wünschst. Hier kommen Systemprompts ins Spiel – eine Art „Grundeinstellung“ für deine Unterhaltung.

Über das Icon rechts oben kannst du solche Systemprompts hinterlegen. Schreibst du dort zum Beispiel „Antworte immer auf Deutsch“, wird das Modell diese Vorgabe befolgen.

LM Studio: Einstellungen optimieren für bessere Performance

Manchmal reagiert ein Modell zu langsam, oder es „vergisst“ frühere Teile der Unterhaltung. Beide Probleme lassen sich über die Token-Einstellungen lösen.

Über das Zahnrad oben in der Mitte gelangst du zu den Token-Einstellungen. Dort kannst du die Kontextlänge anpassen – sozusagen das „Gedächtnis“ des Modells. Diese Einstellung lässt sich flexibel konfigurieren und an deine Bedürfnisse anpassen:

- Höhere Tokenzahl = Das Modell erinnert sich an längere Gespräche, braucht aber mehr Rechenleistung

- Niedrigere Tokenzahl = Schnellere Antworten, aber kürzeres Gedächtnis

Wird dein Computer langsam, reduziere die Tokenzahl. Vergisst das Modell wichtige Informationen, erhöhe sie.

Kleiner Spoiler: Bei meinen Tests mit alternativen Tools wie Hyperlink hat genau diese Kontextlänge massive Probleme verursacht. LM Studio bietet dir hier deutlich mehr Kontrolle und Flexibilität. Weitere Details zu diesen Herausforderungen und wie verschiedene Tools damit umgehen, erfährst du im VIERTEN BLOGARTIKEL dieser Serie.

Meine Praxis-Tests: Drei Use Cases im Überblick

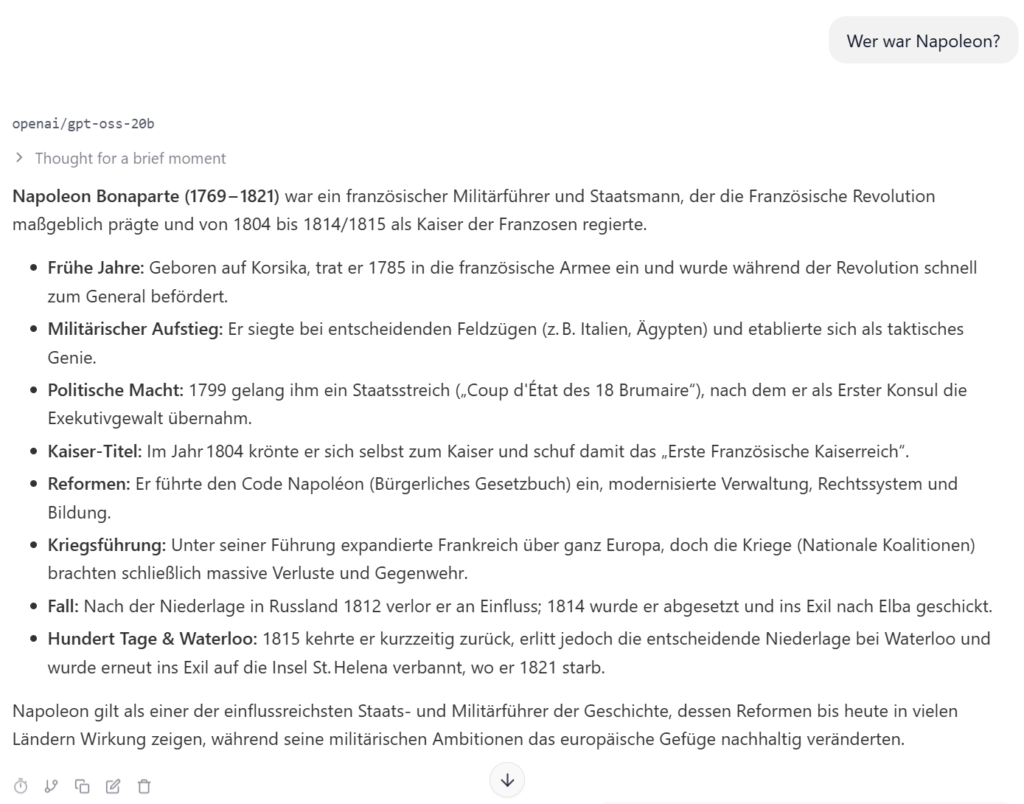

Um die tatsächliche Leistungsfähigkeit von LM Studio zu testen, habe ich drei verschiedene Szenarien durchgespielt – vom einfachen Chat bis zur Dokumentenanalyse. Dafür habe ich mich für das Modell „openai/gpt-oss-20b“ entschieden, also 20B = 20 Milliarde Parameter.

Test 1: Einfacher Chat – Napoleon Bonaparte

Der erste Test war simpel: Ein klassisches Gespräch über historische Themen, konkret über Napoleon Bonaparte. Hier konnte LM Studio seine Stärken ausspielen – die Antworten waren fundiert, gut strukturiert und inhaltlich korrekt.

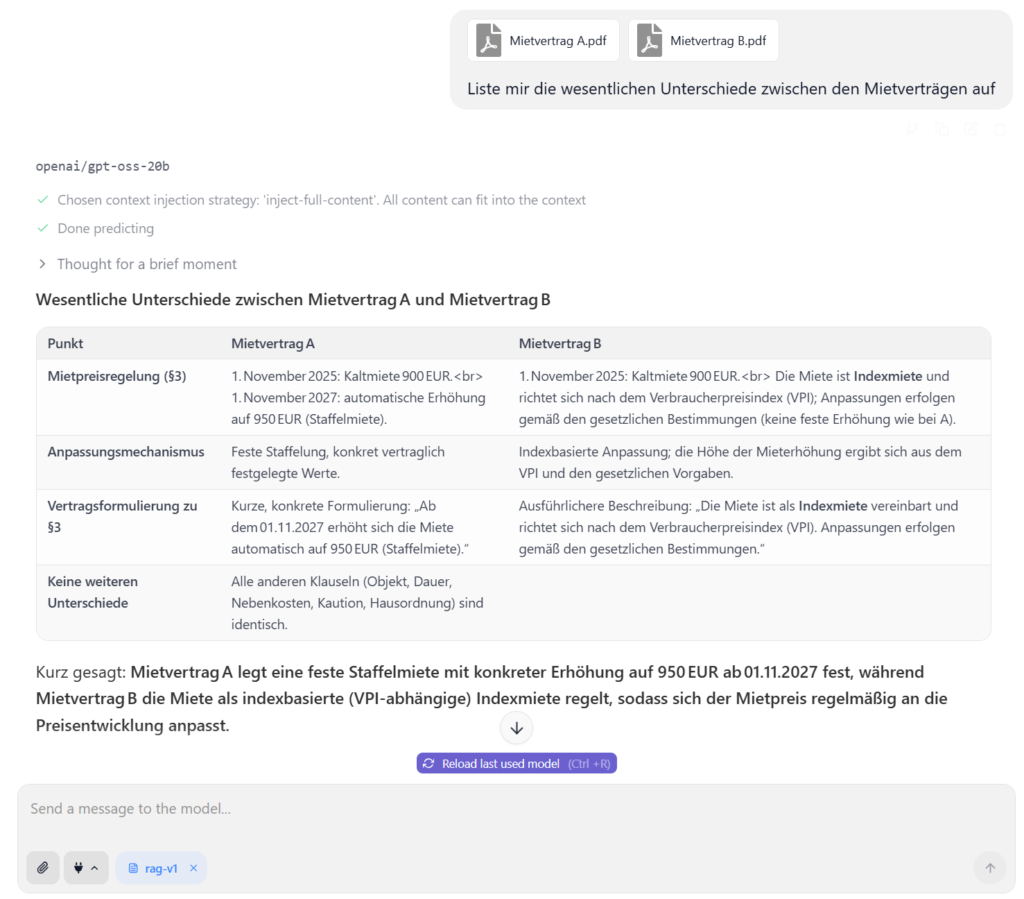

Test 2: Mietvertragsvergleich

Deutlich anspruchsvoller war der zweite Test: Der Vergleich zweier Mietverträge. Hier musste das Modell nicht nur Dokumente analysieren, sondern auch Unterschiede herausarbeiten und strukturiert präsentieren. LM Studio meisterte auch diese Aufgabe überzeugend – die wichtigsten Abweichungen zwischen den Verträgen wurden klar erkannt und verständlich aufbereitet.

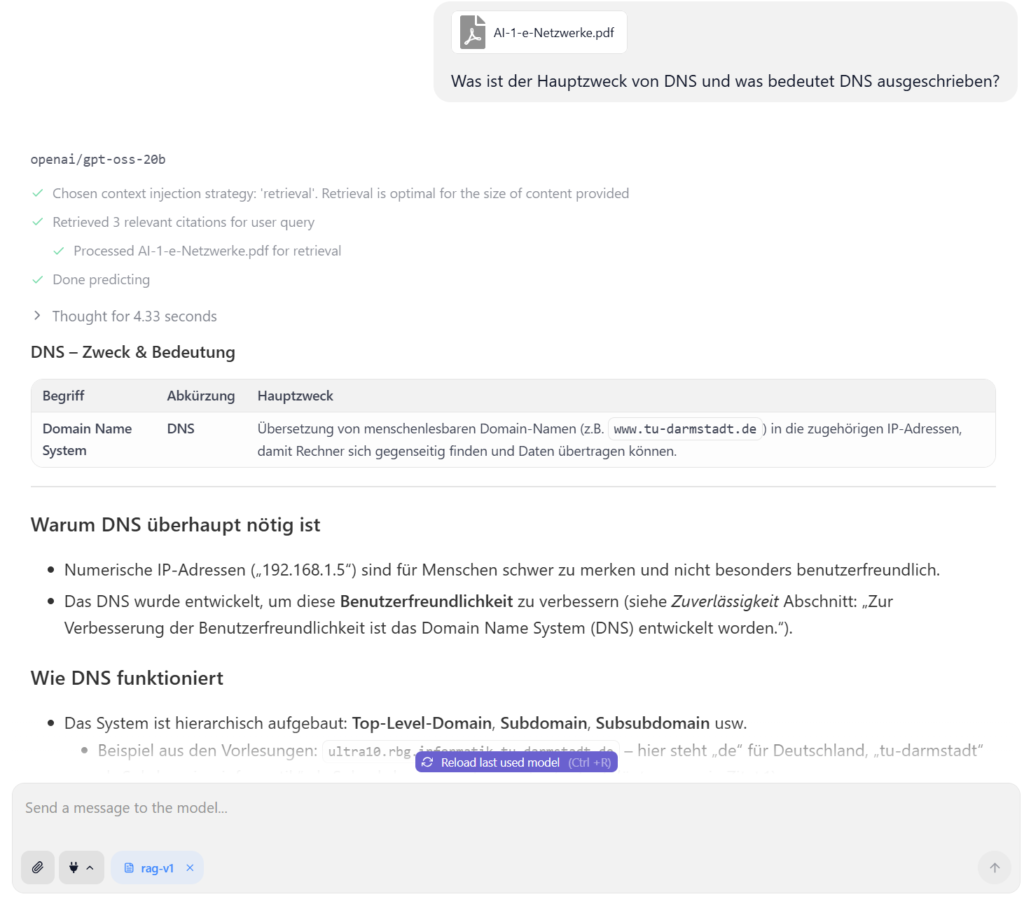

Test 3: Chat mit einem lokalen PDF-Skript

Im dritten Test habe ich ein komplexes PDF-Dokument zum Thema „Netzwerktechnik“ hochgeladen und spezifische Fragen dazu gestellt. Auch hier lieferte LM Studio zuverlässige Ergebnisse. Das Modell konnte relevante Informationen aus dem Dokument extrahieren und sinnvoll in seine Antworten einbinden.

Mein Fazit: LM Studio überzeugt auf ganzer Linie

Nach intensiven Tests bin ich sehr zufrieden mit LM Studio und besonders begeistert darüber, dass ich das Modell „openai/gpt-oss-20b“ mit meiner Hardware (siehe Details im ersten Blogartikel dieser Serie) erfolgreich zum Laufen gebracht habe, was vor allem an der Konfigurationsmöglichkeit der Kontextlänge liegt. Alle drei Use Cases haben zufriedenstellende Ergebnisse erzeugt.

LM Studio ist eine hervorragende Wahl, wenn du:

- Sprachmodelle lokal und offline nutzen möchtest

- Eine benutzerfreundliche Alternative zu Kommandozeilen-Tools suchst

- Modelle direkt von Hugging Face ausprobieren willst

- Bereit bist, dich ein wenig mit Modellgrößen und Einstellungen zu beschäftigen

- Professionelle Dokumentenanalyse ohne Cloud-Anbindung benötigst

Die Software ist nicht Open Source, bietet aber im Gegenzug deutlich mehr Komfort als viele Alternativen. Wenn du neugierig auf lokale KI bist und nicht stundenlang Konfigurationsdateien bearbeiten möchtest, ist LM Studio genau das Richtige für dich. Probier es einfach mal aus – der Einstieg ist kostenlos und in wenigen Minuten erledigt!